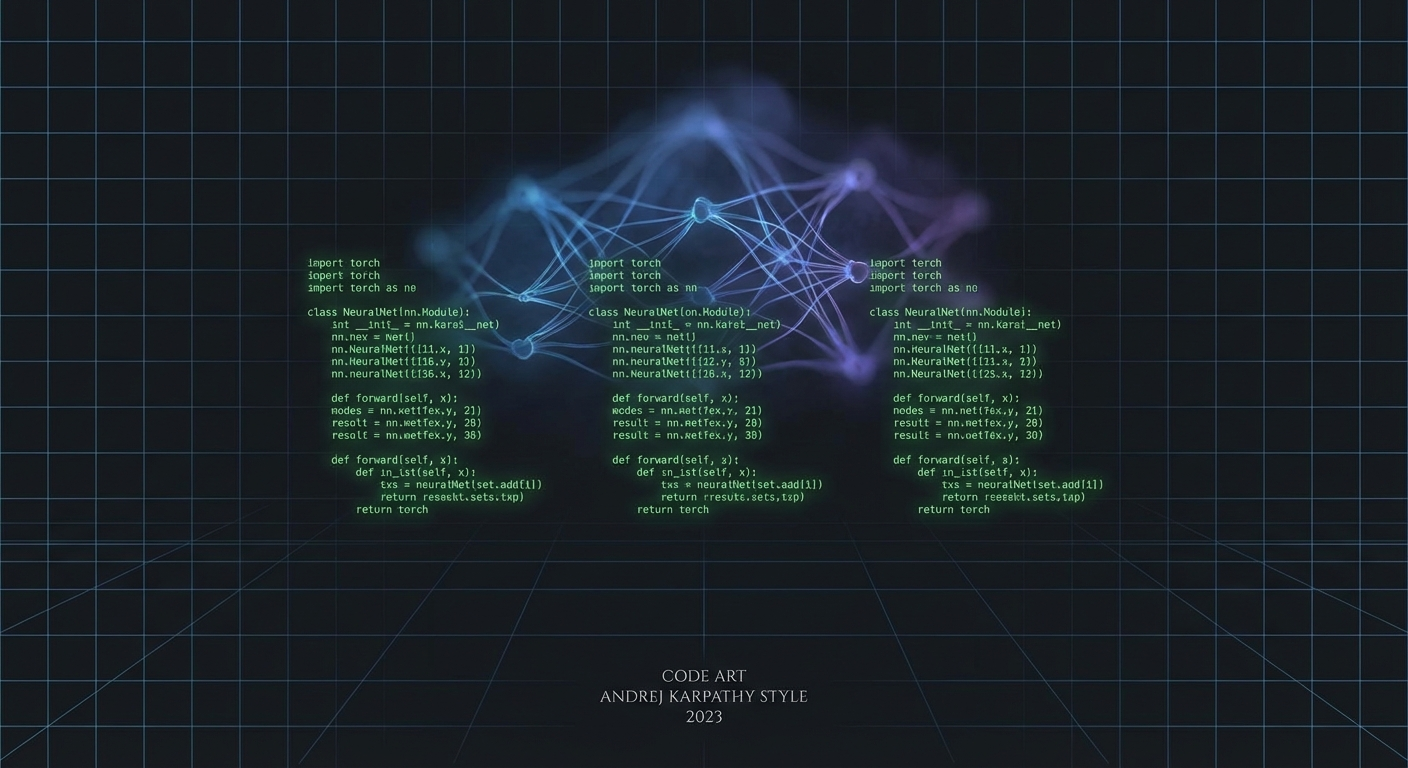

Karpathy droppt MicroGPT: Ein komplettes LLM in 200 Zeilen Python

Andrej Karpathy hat es wieder getan. Der Ex-Tesla-AI-Chef und Mitgründer von OpenAI hat MicroGPT veröffentlicht – ein vollständiges GPT-Modell in exakt 200 Zeilen purem Python. Keine Dependencies. Kein PyTorch. Kein TensorFlow. Nur Python und pure Mathematik.

Was steckt drin? Alles. Tokenizer, Autograd-Engine, GPT-2-Architektur, Adam-Optimizer, Training Loop und Inference. Das komplette algorithmische Fundament moderner Sprachmodelle, destilliert auf das absolute Minimum. Karpathy nennt es selbst 'wunderschön' – und er hat recht.

Das Projekt ist der Höhepunkt einer Dekade der Vereinfachung: micrograd, makemore, nanoGPT – jedes Projekt wurde minimalistischer. MicroGPT ist der logische Endpunkt. Es trainiert auf einem Dataset von 32.000 Namen und generiert danach plausible neue: 'kamon', 'yeran', 'liole'. Klein, aber es funktioniert.

Die pädagogische Bedeutung ist enorm. Jeder, der verstehen will, wie LLMs wirklich funktionieren, kann jetzt jede einzelne Zeile lesen und nachvollziehen. Keine Black Boxes mehr. Keine magischen Bibliotheken. Das ist Open Education in Perfektion.